データ保存システム OceanStor A800

お気に入りに追加する

商品比較に追加する

詳細

大規模なAIモデルのパラメータは、数千億から数兆へと指数関数的に増大している。トレーニングセットもまた、ユニモーダルからマルチモーダル(画像、動画など)パラダイムへと進化し、その結果、データ量は数千倍にも膨れ上がり、前例のない課題をもたらした。

第一に、膨大な数の小さなファイル間の読み込み性能の悪さが、学習効率を損なっている。

第二に、大規模なモデルパラメータが頻繁に最適化されるため、トレーニングプラットフォームが不安定になり、平均2日おきにサービスが中断され、TBレベルのチェックポイントの読み書きに頻繁に時間がかかるようになった。

第三に、1,000億パラメータのモデルをトレーニングするには、膨大なGPUリソースが必要です。個々のGPUでは十分な効率が得られず、会話アプリケーションのミリ秒レベルのリアルタイム推論を確保することは非常に困難です。

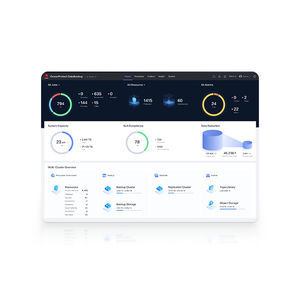

OceanStor A800は、単一のコントローラーエンクロージャー内で驚異的な2,400万IOPSと500GB/秒の帯域幅を実現し、高性能AIナレッジリポジトリストレージソリューションとして機能します。次点の4倍の性能を持つOceanStor A800は、トレーニングセットの少量ファイルロードや高帯域幅ベースの再開可能なトレーニングに必要なストレージシステムです。また、250,000 QPSを超える大規模モデル推論アプリケーションをサポートし、ベクトル検索の高速化とミリ秒レベルの推論応答を実現する、最先端の固有ベクトル知識リポジトリへのアクセスも利点となります。

超高性能

当社の画期的なデータ制御分離アーキテクチャは、データのディスクへの直接フローを促進し、CPU使用率を低減し、コントローラ・エンクロージャあたり2,400万IOPSを実現します。

---

カタログ

この商品のカタログはありません。

Huawei Technologies Co., Ltdの全カタログを見る